Sosem látott mértékben árasztották el félrevezető háborús AI-képek a netet az izraeli–iráni konfliktus alatt

2025. június 25. 12:39

Ezt a cikket 2025 júniusában írtuk.

A benne lévő

információk azóta elavulhattak.

AI-generált vadászgépek, hamis tüntetések, és egy másfélmillió követővel rendelkező rejtélyes X-fiók – az izraeli–iráni háború a közösségi médiában is zajlik.

A szakértők a 2025. június 13-án kezdődött izraeli–iráni katonai konfliktust kísérő jelentős dezinformációs hullámról számolnak be, különös tekintettel az AI (mesterséges intelligencia) által generált félrevezető vizuális tartalmakra. „Pakisztánból származó, nem kapcsolódó felvételektől kezdve a 2024. októberi sztrájkokról készült újrafelhasznált videókig mindent látunk” – írta a helyzetről a GeoConfirmed közösségi alapú, nyílt forráskódú nyomozással és geolokációval foglalkozó szervezet.

Emmanuelle Saliba, a Get Real elemzőcsoport vezető nyomozója arról beszélt a BBC Verify-nak: korábban még nem láttak olyat, hogy a generatív AI-t ilyen nagy mértékben használták volna egy katonai konfliktus kapcsán. Ezekből mutatunk pár jellemző példát.

A nem létező F–35-ös gép „megsemmisítése”

Iráni közösségimédia-oldalak több különböző kontextusban is osztottak meg hamis felvételeket egy Lockheed Martin F–35 Lightning II típusú amerikai vadászgép állítólagos megsemmisítéséről. Az AI-generálta képek terjedését az indíthatta be, hogy iráni források azt állították, az ország több izraeli F–35-öst lelőtt. Lisa Kaplan, az Alethea elemzőcsoport vezérigazgatója megjegyezte a BBC Verify-nak: hogyha az összes hamis felvétel valódi lenne a repülőgépről, akkor az gyakorlatilag azt jelentené, hogy Izrael vadászgépflottájának a 15 százalékát megsemmisítették.

A fenti kép különösen nagy karriert futott be: a fotón egy sivatagi tájban látszik egy vadászgép, egyik szárnya leszakadt, több helyen megsérült, körülötte emberek állnak és autók parkolnak. A kép a szakértői vélemények alapján egyértelműen AI-jal készült, és erre több jel is utal. Az F–35 Lightning II a valóságban ennél kisebb egy emberhez viszonyítva: az Amerikai Légierő oldalán található információk szerint 15,7 méter hosszú, szárnyszélessége 10,7 méter. aAgyártó oldalán található videóban egy pilóta áll a gép mellett, amiből szintén látszanak a helyes arányok. (2016-ban 50 darab, az izraeli hadsereg számára továbbfejlesztett F–35-ös vadászgépet vásárolt Izrael, ők kaptak elsőként ilyen vadászgépet az Egyesült Államokon kívül.)

A képen a felfestés is hibás. Az alábbi fotón láthatjuk, hogy az izraeli légierő F–35 Lightning II vadászgépe egy légi bemutatón vesz részt Tel-Avivban 2023. április 26-án: a szárnyakon lévő felfestés nem azonos.

A Snopes amerikai tényellenőrző oldal megkereste az izraeli hadsereget, ami megerősítette az oldalnak szóvivőjük korábbi X-bejegyzését, mely szerint Irán nem lőtt le izraeli vadászgépeket.

A képet ellenőriztük Google fordított képkereséssel is. Nem találtunk olyan megbízható forrást, ami valódinak tekintette volna. A platform közlése szerint a kép a Google AI segítségével készült.

Az F–35-ös vadászgép állítólagos lelövéséről egy magánkézben lévő iráni tévécsatorna is megosztott egy másik képet. Ezen is egy vadászgép maradványai láthatók, de éjszaka. A fotó a közösségi média felületeken is keringett, az Orientalista néven működő magyar oldal is írt róla egy cikket, és megosztotta azt a 14 ezer követővel rendelkező Facebook-oldalán.

Azonban ez a fotó is mesterséges intelligenciával készült: a perzsa Fact Nameh tényellenőrző oldal cikke több hibát is talált a fotón: nem stimmelnek a méretarányok, a felfestés, és a gép túl kicsi a fűszálakhoz képest. A lengyel Demagog tényellenőrző lap pedig egy AI-detektor szoftverrel tesztelte a képet, ami szintén azt az eredményt hozta, hogy mesterséges intelligenciával készült a kép. A fotót a Meta rendszere is manipulált fényképnek címkézte:

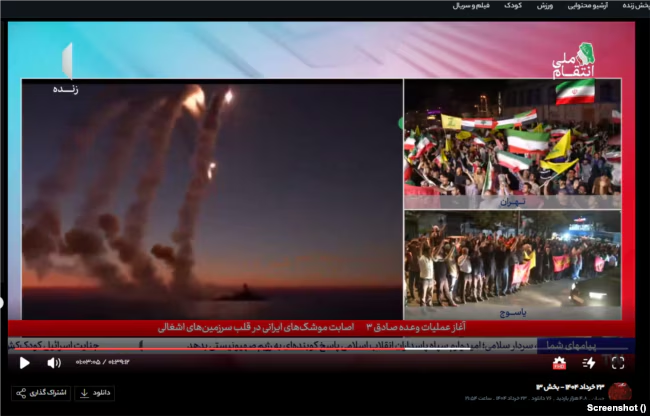

Az egyszerű módszerekkel készülő AI-képek mellett egy másik gyors és olcsó dezinformációs eszköz a régi felvételek újrahasznosítása. Például az iráni állami kézben lévő IRIB TV1 híradója bemutott egy felvételt, amelyen egy rakéta felrobban a tenger felett – ez azonban évekkel ezelőtt készült. Fordított képkereséssel az RL Fact Check megtalálta az eredeti felvételt, amit a leírás szerint a Fekete-tengeren rögzítettek, orosz rakétákról.

A BBC Verify több tucat olyan közösségimédia-bejegyzést talált, amelyek Irán válaszlépéseinek hatékonyságát próbálták bizonyítani, például a támadások utóhatásait ábrázoló hamis AI-tartalmakkal. Az elemzésükben szereplő három legnézettebb videó együttesen több mint 100 millió megtekintésnél jár.

Hamis tüntetések és további AI-képek

Az Izraelt támogató közösségimédia-fiókok körében is megjelentek mesterséges intelligencia által generált megtévesztő tartalmak. Széles körben elterjedt például egy videó, amelyen látszólag iráni fiatalok azt skandálják Teherán utcáin, hogy „szeretjük Izraelt”. A videón azonban jól kivehetők az AI-ra jellemző vizuális hibák, ráadásul a készítő maga sem próbálta elrejteni a tartalom mesterséges eredetét. A videót egy izraeli AI-művész tette közzé TikTokon, és egyértelműen megjelölte, hogy a videó AI-generált. Ennek ellenére ilyen megjelölés nélkül is terjedt a közösségi médiában.

Egy másik, több mint 660 ezer megtekintést elérő TikTok-videó azt állította, hogy az izraeli támadások során június 13-án elszenvedett és elpusztított iráni helyszíneket mutatja be. Azonban a DW tényellenőrzése kimutatta: a felvétel AI-generált, és laikus szemmel is kiszúrhatók benne zavaró részletek, egyes alakok fokozatosan eltűnnek a képből, a tűzoltók mozdulatlanok, a videóban látható rakétatörmelékek között két nyílhegy is feltűnik. A videót közzétevő fiókot azóta törölték.

Olyan archív képsorokat is terjesztettek, amelyek korábbi iráni tüntetéseken vagy rakétatámadások során készültek, és azt sugallták, hogy az iráni közvélemény Izrael katonai akcióit támogatja. (Egy hasonló dezinformációs mintázatot azonosítottunk korábban a Hezbollah rakétatámadásai idején is, erről korábbi cikkünkben írtunk bővebben.)

Elterjedt egy videó egy esőben táncoló nőről, ezt a megosztók azzal kommentálták, hogy Iránban készült, és az izraeli támadások hatására felszabaduló iráni nők örömét mutatja. A 6 millió megtekintést és több mint tízezer újraosztást elérő videót valójában már 2023 nyarán megosztotta egy Franciaországban élő személyi edző, aki maga is reagált a félrevezető állításokra: 2025. június 20-án újra közzé tette a felvételt, és tisztázta, hogy nem iráni, hanem grúz származású, és semmi köze nincs az iráni–izraeli konfliktushoz.

Hasonló logika mentén terjedt el újra egy 2022-es felvétel, amelyen iráni diáklányok fejkendőiket levéve tiltakoznak. A közösségi médiában ezt a képsort úgy állították be, mintha a jelenlegi eseményekre reagálva ünnepelnék a felszabadulásukat – így bizonyítva, hogy az izraeli támadások belső zavargásokat és rendszerszintű ellenállást váltottak ki Iránban. Az esetenként akár 7 millió megtekintést elérő videó valójában 2022. szeptember 16-án készült, és a 22 éves Mahsa Amini halála nyomán kirobbant tüntetések egyik pillanatát rögzíti..

Egy rejtélyes X-felhasználó és egy félrevezető IDF-közlés

A manipulatív felvételek terjesztőiről keveset tudni, az viszont látszik, hogy egyes fiókoknak már a neve és kinézete is szándékosan félrevezető. Ilyen például az 1,6 millió követővel rendelkező, rendszeresen dezinformáló Irán-párti Daily Iran Military. Az iráni hadsereget idéző névválasztás és a kék pipa a neve mellett arra utal, hogy hivatalos oldalról van szó – de nem lehet tudni, hogy ki működteti a fiókot.

Mindemellett hivatalos források is terjesztettek hamis felvételeket.

Például az Izraeli Védelmi Erők (IDF) hivatalos X-oldalán megosztottak egy archív felvételt a következő kommentárral: „Nyers felvétel: Irán az elmúlt órákban több ballisztikus rakétát lőtt ki Izrael felé. Az Izraeli Védelmi Erők nem engedhetik meg, és nem is fogják megengedni, hogy Irán megtámadja a civiljeinket.” A mellékelt videót azonban már 2024 októberében is közzétették. (Erre a félrevezető közlésre a francia köztévében is felhívták a figyelmet.)

A szerzőkről

Dezső Annamari

2024-től a Lakmusz gyakornoka, majd újságírója. Egyetemi tanulmányait az ELTE szociológia alapszakán, majd az ELTE kommunikáció- és médiatudomány mesterszakán végezte. Az Achilles Data nemzetközi oknyomozó újságíró program nyertes csapatának tagja.

Barczikai Fanni

A Budapesti Corvinus Egyetemen végzett politológus, az ELTE-BTK mesterszakos hallgatója. Az Achilles Data nemzetközi oknyomozó újságíró program díjazottja és a Pelikán Projekt okleveles újságírója. A Lakmusz csapatához 2024 márciusában csatlakozott.

Kövess minket!

Ne maradj le egy anyagunkról sem, kövess minket máshol is!

Ajánlott cikkeink

Miközben itthon a sebeit nyalogatja a propaganda, külföldön éppen hogy felpörgött a Magyar Pétert támadó dezinformáció

Lakmusz participates in a project aiming to develop innovative fact-checking formats