8 lépés, amivel a techcégek biztonságosabbá tehetnék platformjaikat a női felhasználók számára

2025. április 11. 09:25

Ezt a cikket 2025 áprilisában írtuk.

A benne lévő

információk azóta elavulhattak.

Az angolban már külön mozaikszó van a technológia által elősegített nemi alapú erőszakra: TFGBV. A jelenség 10 nőből négyet közvetlenül is érint, és bár lennének módszerek a megelőzésére, az online platformok egyelőre nem alkalmazzák ezeket kellően széles körben.

Az Economist Intelligence Unit felmérése szerint világszerte a nők 38 százaléka tapasztalta meg személyesen az online erőszak valamely formáját, a más nők elleni online erőszaknak pedig a nők 85 százaléka legalább egyszer tanúja volt.

Az ENSZ Népesedési Alapja (UNFPA) a technológia által elősegített nemi alapú erőszakot (TFGBV, technology-facilitated gender-based violence) olyan erőszakos cselekményként definiálja, amelyet az áldozat nemi hovatartozása alapján követnek el, és amit részben vagy egészben az információs és kommunikációs technológiák vagy a digitális média használata tesz lehetővé, támogat vagy súlyosbít.

Ez lehet

- online zaklatás,

- doxolás (személyes adatok kiszivárogtatása),

- cyberstalking (online üldözés),

- vagy gyűlöletbeszéd a nők ellen.

Az online erőszak az áldozatra gyakorolt közvetlen hatások mellett általában is dermesztő hatással van a nőkre.

Az online bántalmazás eredményeként a nők az online térből való visszavonulásra kényszerülhetnek, amivel nemcsak a nyilvánosság sokszínűsége, hanem a nők önérvényesítési joga és szólásszabadsága is sérül.

Az Integrity Institute, a Search for Common Ground és a Council on Technology & Social Cohesion márciusban kiadott közös jelentése szerint a TFGBV iparági szintű probléma, a közösségi média-platformok felépítése kifejezetten elősegíti a nők elleni online erőszakot. Bár a platformok jelenlegi gyakorlatában léteznek megoldások ennek visszaszorítására, ezek nagyrészt utólagos, reaktív intézkedések, amelyek már csak a bántalmazás bekövetkezte után alkalmazhatók – ilyen például a tartalommoderálás.

Ezzel szemben a jelentést készítő szervezetek proaktív megközelítést javasolnak. Arra hívják fel a figyelmet, hogy már a platformok tervezése és fejlesztése során elengedhetetlen szempont a felhasználók biztonsága, az online teret pedig eleve úgy kellene kialakítani, hogy az megelőzze és csökkentse a digitális erőszak előfordulását.

Fotó: Jaque Silva/AFP

Jelentésükben ehhez nyolc stratégiai elemet javasolnak a techcégeknek.

A nők online biztonságát elősegítő lehetséges megoldások egy része a felhasználókra koncentrál: az online erőszak potenciális elkövetőit próbálja elrettenteni, a lehetséges áldozatoknak pedig segíti a védekezésben. A javasolt intézkedések másik része a platformok strukturális elemeit, például a rangsoroló algoritmusokat célozza.

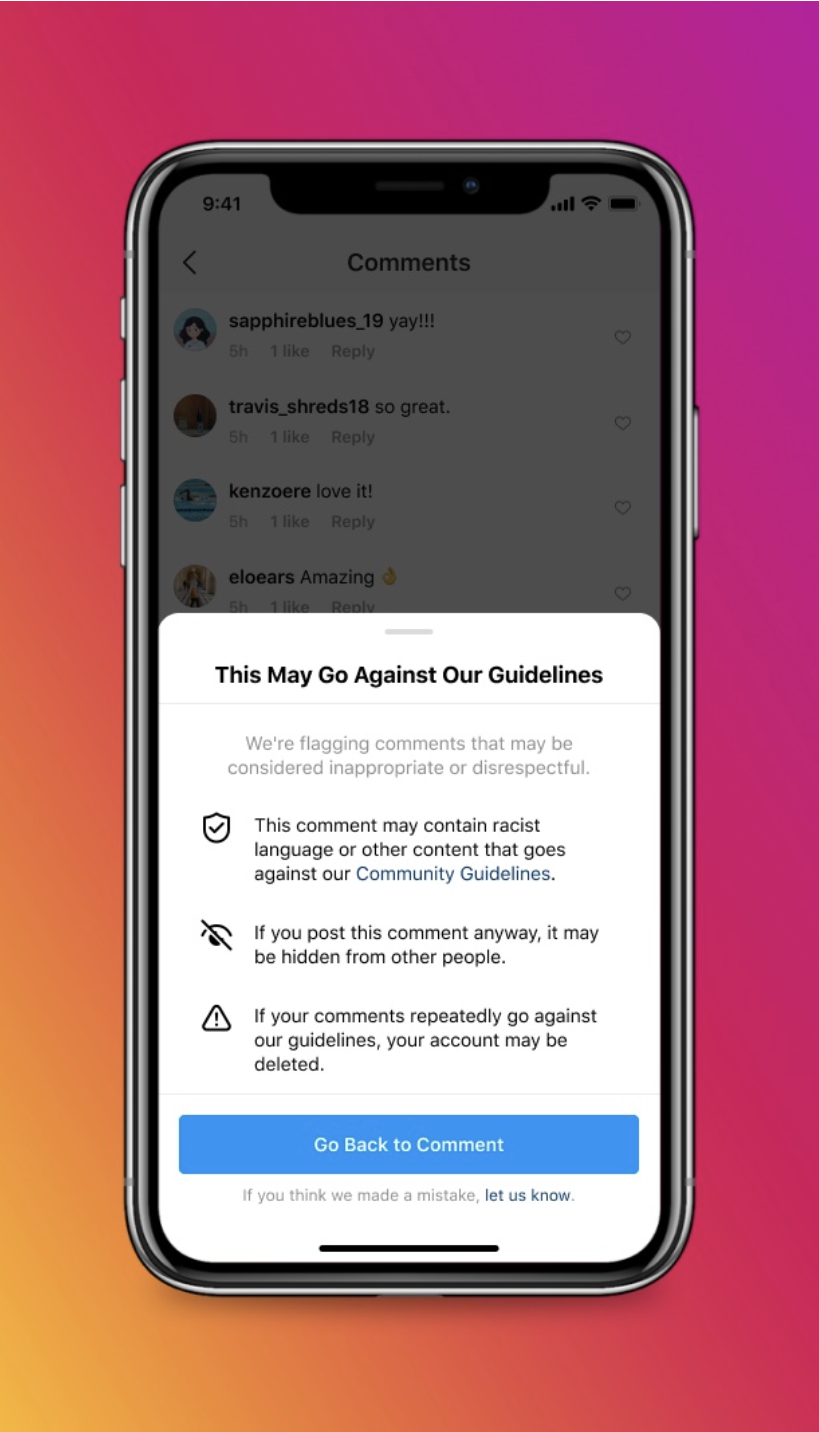

1. Nudging

A nudging technika olyan valós idejű figyelmeztetéseket jelent, amelyekkel a platformok közösségi irányelveik betartatására ösztönzik a felhasználókat. Elsősorban a gyűlölködő posztok és kommentek ellen alkalmazható.

A figyelmeztető, elrettentő üzenetek akkor jelennek meg, amikor valaki sértő, gyűlölködő tartalom közzétételére készül, és arra ösztönzik a felhasználót, hogy posztolás vagy kommentelés előtt gondolja át a potenciálisan ártalmas nyelvezet alkalmazását.

Így a reaktív megoldás – mint a tartalom utólagos jelentése – helyett már a közzététel előtt hatásos az online erőszak ellen.

Az Instagram felugró üzenete a közösségi irányelveket sértő kommentek esetében. Forrás: Instagram

Ezt a módszert már használja a gyakorlatban az X és az Instagram, a két platform gyakorlatából pedig az látszik, hogy a nudging valóban elrettentő hatással bír, és csökkentheti a sértő kommentek számát.

Az Instagram például korábban arról számolt be , hogy egy hét alatt átlagosan napi egymillió ilyen figyelmeztető üzenetet küldtek ki, aminek hatására a felhasználók az esetek 50 százalékában törölték vagy módosították kommentjeiket.

Az Integrity Institute és partnerei által jegyzett jelentés kifejezetten bátorítja az AI használatát a nudging fejlesztésére. Például adaptív nyelvfelismerő vagy képészlelő algoritmusokkal a platformok felismerhetik a zaklatást vagy az NSFW (not safe for work) tartalmakat, és ez alapján személyre szabott figyelmeztetéseket küldhetnek.

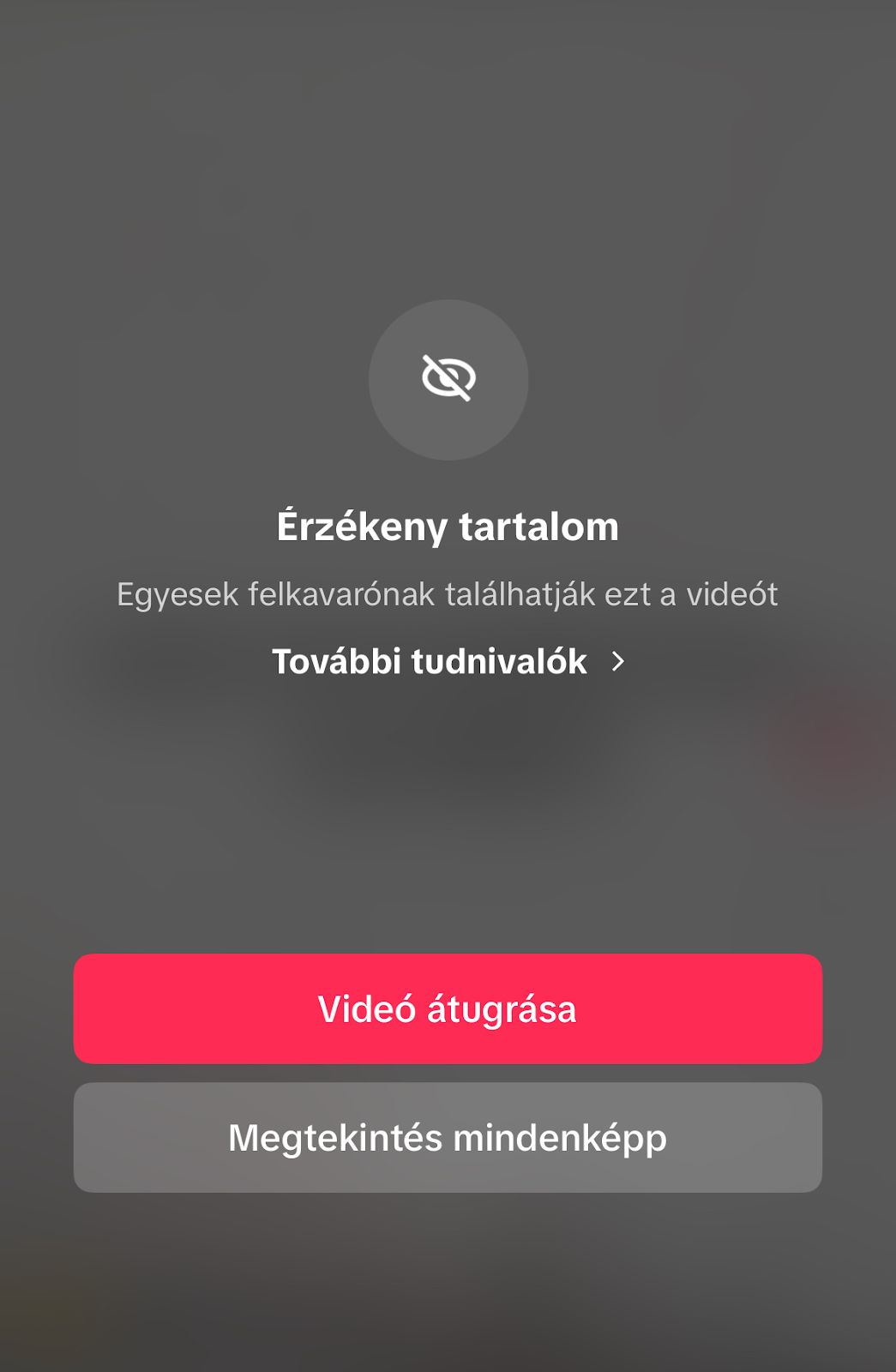

2. Szűrők

A platformok jelenleg is használnak tartalomszűrő és -szabályozó módszereket, a TikTok például automatikusan megjelöli az olyan kereséseket és tartalmakat, amelyek potenciálisan ártalmasak lehetnek, ami után a felhasználó választhat a tartalom megtekintése és elkerülése között.

Képernyőkép egy érzékeny tartalomnak jelölt TikTok videóról. Forrás: TikTok

A jelentés azonban olyan szűrők kialakítását ajánlja a platformok számára, amelyeket a felhasználók saját igényeik szerint, saját maguknak szabhatnak testre. Blokkolhatnak például bizonyos kulcsszavakat.

Az Instagramon egy ehhez hasonló funkció szintén elérhető. Az „Elrejtett szavak” segítségével a felhasználók saját listát állíthatnak össze olyan a kifejezésekkel, amelyekkel nem szeretnének találkozni. Így a megadott személyes beállítások alapján a kéretlen tartalmú üzenetküldési engedélykérések egy külön mappában jelennek meg.

A platform jelentése szerint egy évvel a funkció bevezetése után a nagy követőszámú (legalább 10 ezer követővel rendelkező) profilok a korábbinál 40 százalékkal kevesebb sértő kommenttel találkoztak.

3. Tudatosságnövelés

A jelentésben arra is felhívják a figyelmet, hogy az egyes platformokra újonnan regisztrált felhasználók megfelelő felkészítése elengedhetetlen az online biztonságuk érdekében.

Így a platformoknak első körben figyelmet kell fordítaniuk az oktatásra, különösen a biztonsági eszközökkel, az adatvédelmi beállításokkal és a közösségi irányelvekkel kapcsolatban.

Emellett a későbbiekben automatizált, mérföldkő-alapú emlékeztetőkkel tehetnek a tudatosság növeléséért, így a felhasználók tevékenységük kiszélesedésével párhuzamosan folyamatosan naprakészek maradhatnak arról, milyen eszközök és beállítások állnak rendelkezésükre. Ilyen mérföldkő-alapú megoldások például az első poszt alkalmával, vagy a csoportokhoz való csatlakozás során kiküldött adatvédelmi emlékeztetők és biztonsági figyelmeztetések.

A jelentés konkrét példaként hozza, hogy ha egy felhasználó sok kommentet vagy üzenetet rejt el, a platform célzottan figyelmeztethetné a szűrők létrehozásának lehetőségére. Hasonlóképpen, ha egy felhasználó első alkalommal oszt meg virális tartalmat, figyelmeztetést kaphat az ezzel járó nagyobb kitettségről és az elérhető adatvédelmi beállításokról.

4. Online visszaélések bejelentése, dokumentálása

A Revenge Porn Helpline 2023-ban arról számolt be, hogy a nők a férfiaknál 28-szor nagyobb valószínűséggel vannak kitéve a róluk készült intim képek beleegyezés nélküli terjesztésének.

Az adataik alapján ugyanabban az évben több mint 200 ezer ilyen képet távolítottak el az internetről.

Az Instagram a bosszúpornó és szextorzió (szexuális zsarolás) visszaszorításának érdekében már tiltja, hogy képernyőfotókat lehessen készíteni a privát üzenetben küldött, eltűnő képekről és videókról.

A jelentés szerint az ilyen gyakorlatokon kívül a platformok elsősorban az egyszerűsített bejelentőrendszerek létrehozásával, illetve az automatikus és titkosított bizonyítékrögzítéssel segíthetik a visszaélések áldozatait. Ilyen módszer a bizonyítékok platformokon átívelő dokumentációja, amely lehetővé teszi a visszaélések bizonyítékainak – mint képernyőképek és metaadatok – gyűjtését és megosztását több platformon keresztül.

Ez egyben ösztönözné a platformokat, hogy együttműködjenek egymással a több platformon is aktív elkövetők felelősségre vonásában.

5. Az elérésalapú algoritmus megváltoztatása

A platfromok többsége elérésalapú algoritmust használ (engagement-based content ranking), amely a legtöbb interakciót – megosztás, like, kommentek – kiváltó tartalmakat részesíti előnyben.

Ez a fajta tartalomrangsorolás ugyanakkor a szenzációhajhász tartalmaknak kedvez, és így az erőszakos tartalmak és visszaélések terjedésének melegágya, de a gyűlöletkeltő vagy szélsőséges ideológiák népszerűsítését is segíti.

A Cambridge-i Egyetem kutatása arra hívta fel a figyelmet, hogy a Facebookon és a Twitteren a megosztó tartalmak kétszer olyan gyorsan terjednek, mint a semlegesek, de az Equimundo Manosphere-Rewired jelentése szerint a nőgyűlölő tartalmakat szintén előkelő helyeken rangsorolják ezek az algoritmusok.

Fotó: Jaap Arriens/AFP

Az Integrity Institute, a Search for Common Ground és a Council on Technology & Social Cohesion jelentésének szerzői szerint az elérés alapú algoritmusok helyett a tartalmak rangsorolása során a biztonságnak és a minőségnek kellene a két legfőbb szempontnak lennie.

Ehhez a platformoknak elsősorban a forrás – vagyis a közzétevő – hitelességét és megbízhatóságát kellene vizsgálniuk, ezen kívül lehetőséget kellene biztosítaniuk a felhasználóknak, hogy a hozzájuk eljutó tartalmat értékelhessék, hogy a hírfolyam a saját preferenciájuknak megfelelően alakuljon. Emellett kiemelik még az algoritmus átláthatóságát, arra szólítják fel a platformokat, hogy hozzák nyilvánossára a rangsorolási szempontjaikat.

Pozitív példaként említik a jelentésben, hogy 2012 óta a YouTube már nemcsak a kattintások számát veszi figyelembe a videók rangsorolása során, hanem a kattintások és a megtekintési idő kombinációját. A platform az átállással inkább olyan videókat kezdett ajánlani, amelyeket tovább néznek a felhasználók. Bár a modell eleinte kevesebb a kattintást hozott, hosszútávon a nézőmegtartás arányában növekvő tendencia rajzolódott ki.

6. Szürkezónás tartalmak elkülönítése

A tartalmak túlzott cenzúrázása és az alulmoderálás közötti egyensúly megteremtésének egy jó eszköze lehet az olyan „ karanténrendszerek” kialakítása, amelyek ideiglenesen elkülönítik a megjelölt tartalmakat egy külön moderálási térbe.

Tehát az ilyen tartalmak a végső moderálási döntés meghozataláig alapértelmezetten el vannak rejtve, de a felhasználók eldönthetik, hogy megtekintik-e e őket.

A legtöbb platform gyakran alkalmazza a jelentésben is említett shadowbanning-módszert. Ilyenkor egyes, nem megfelelőnek ítélt tartalmakat ideiglenesen elrejtenek a többi felhasználó elől. Ezt használja a Tiktok is, amikor a biztonsági központ szerint nem megfelelő tartalmat gyakran megosztó profilok tartalmai kikerülnek a For You hírfolyamból.

Az Instagram Restrict-funkciója pedig konkrét esetekben, például zaklatás során használható. Ennek segítségével a felhasználók tiltás nélkül kezelhetik az őket zaklató profilokat. A felhasználó által korlátozott fiók kommentjeit csak ő látja, a tőle érkező üzenetek pedig külön helyre kerülnek. A felhasználó megnézheti ezeket, de anélkül, hogy erről a potenciálisan zaklató küldő értesülne.

7. Magasabb fokú adatvédelem

A jelentés szerint a platformok fejlesztőinek már a tervezés során is a biztonságot kell elsődleges szempontként kezelniük, és alapértelmezetten magasabb fokú adatvédelemmel kell ellátniuk a felhasználók profiljait. Ilyen a profil korlátozott láthatósága vagy a nehezebb kereshetőség.

Ha az alapértelmezett beállítások magasabb fokú védelmet nyújtanak, az biztonságosabb kiindulási pont mindenki számára, a nyilvános profilok ugyanis fokozott veszélyt jelentenek a zaklatás vagy doxolás szempontjából.

Az ehhez hasonló beállítások védelmet nyújthatnak a célzott zaklatások ellen, amelynek áldozatai a kisebbségi csoportok mellet a nők.

A gyakorlatban ilyen az Instagram tizenévesek adatainak védelmét és biztonságát szolgáló beállítása. Az oldal fiatal, (országtól függően 16 vagy 18 év alatti) új felhasználói alapértelmezetten privát fiókot kapnak. Ezen kívül a 18 évesnél idősebb felhasználók nem küldhetek privát üzenetet a tizenéveseknek, továbbá az Instagram az olyan felnőttek profiljai számára, akiket a közelmúltban egy 18 év alatti letiltott vagy jelentett, nem engedélyezi a kamaszok profiljainak követését, és az általuk közzétett tartalmakat sem jeleníti meg számukra.

A TikTok szintén figyelmet fordít a fiatal felhasználói védelmére, a 13-15 éves felhasználók alapértelmezetten olyan beállításokat kapnak, ahol csak jóváhagyott követők láthatják a tartalmaikat, és ilyen profilokon privát üzenet küldése sem engedélyezett.

A Facebook „ Zárolt profil” funkciója, habár pozitív visszhangot váltott ki annak 2020-as indiai bevezetése során – egy év alatt az indiai nők 34 százaléka zárt profilra váltott az oldalon, és a zaklatások száma is kézzelfoghatóan csökkent -, továbbra is csak bizonyos országokban elérhető (Magyarországon sincs a használatára lehetőség).

A zárolt profilok fényképeinek és bejegyzéseinek megtekintését, továbbá a profilkép teljes felbontású megtekintését a Facebook csak a profil ismerőseinek engedi, ami erősíti a zaklatás elleni küzdelmet, a személyes profilok és adatok védelmét.

8. Az újonnan regisztrált és a nem hitelesített profilok tevékenységének limitálása

Az internetes zaklatáshoz és az összehangolt támadásokhoz muníciót biztosíthatnak a spamszerűen, kifejezetten erre a célra létrehozott profilok.

Az ilyen támadások a jelentés ajánlása szerint kiküszöbölhetőek azzal, ha a platformok az újonnan regisztrált és a nem hitelesített fiókokkal szemben korlátozásokat alkalmaznak. A tevékenységük limitálásával, mint a barátkérések, kommentek vagy üzenetek küldése, megakadályozható vagy csökkenthető a visszaélések száma.

Hasonló bejegyzéskorlátozó eszközöket alkalmaz például a Reddit is, az oldal közösségei korlátozhatják az új felhasználók bejegyzéseinek gyakoriságát a visszaélések és a kéretlen tartalmak csökkentése érdekében.

Az ehhez hasonló korlátozások is limitálják a platformok visszaélésszerű használatát és hozzájárulhatnak a nők elleni online erőszak megelőzéséhez.

(A címlapi illusztráció forrása: Didiem Mente/Anadolu/AFP)

A szerzőről

Balogh Boglárka

Egyetemi tanulmányait a BGE kommunikáció- és médiatudomány alapszakán végezte. 2024 júliusában gyakornokként csatlakozott a Lakmuszhoz, 2025 októberétől dolgozik teljes állású újságíróként. 2024 novemberétől egy éven át Thomson Alapítvány nemzetközi gyakornoki programjának résztvevője volt.

Kövess minket!

Ne maradj le egy anyagunkról sem, kövess minket máshol is!